基于三維光場(chǎng)成像的自動(dòng)駕駛傳感器設(shè)計(jì)

最佳展示獎(jiǎng)

資助企業(yè):

奕目(上海)科技有限公司

奕目(上海)科技有限公司

資助年份: 2022

企業(yè)導(dǎo)師: 李浩天

指導(dǎo)教師: 施圣賢

項(xiàng)目成員: 沈宇喆,劉炫佚,馬英挺

項(xiàng)目簡(jiǎn)介

項(xiàng)目簡(jiǎn)介

項(xiàng)目概述

自動(dòng)駕駛汽車在未知的動(dòng)態(tài)環(huán)境中運(yùn)行十分依賴傳感器對(duì)整個(gè)環(huán)境的感知。傳統(tǒng)的自動(dòng)駕駛傳感器難以同時(shí)提供視覺影像和三維信息,相比之下,光場(chǎng)相機(jī)具有一次拍攝即可同時(shí)獲得二維和三維信息的特點(diǎn),因此有望成為新型傳感器。

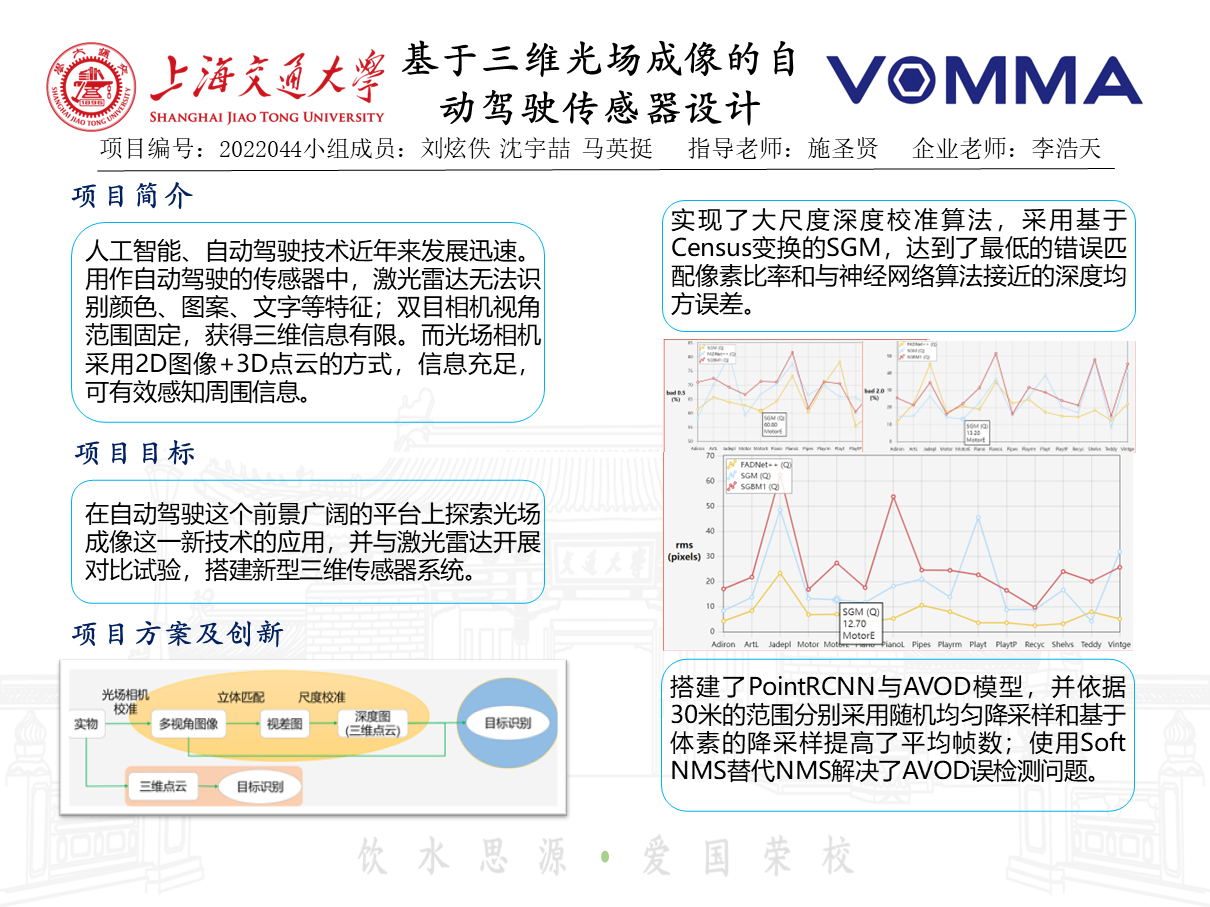

本畢業(yè)設(shè)計(jì)意圖在自動(dòng)駕駛平臺(tái)上探索光場(chǎng)成像這一新技術(shù)的應(yīng)用,并與激光雷達(dá)展開對(duì)比,搭建起新型三維傳感器系統(tǒng)。畢設(shè)完成了大尺度光場(chǎng)深度校準(zhǔn)算法開發(fā)和道路模型檢測(cè)算法開發(fā),以及與激光雷達(dá)點(diǎn)云數(shù)據(jù)進(jìn)行對(duì)比驗(yàn)證了系統(tǒng)的可行性。

項(xiàng)目目標(biāo)

應(yīng)用理想雙目成像模型以及半全局視覺立體匹配算法發(fā)展大尺度深度校準(zhǔn)算法,利用光場(chǎng)相機(jī)對(duì)環(huán)境深度信息進(jìn)行提取以及對(duì)三維信息進(jìn)行重構(gòu)。基于深度學(xué)習(xí)和傳統(tǒng)目標(biāo)識(shí)別算法PointRCNN和 AVOD,開發(fā)光場(chǎng)相機(jī)三維點(diǎn)云及二維多視角圖像數(shù)據(jù)處理算法。搭建激光雷達(dá)點(diǎn)云數(shù)據(jù)處理深度學(xué)習(xí)網(wǎng)絡(luò)PV-RCNN、BtcDet,實(shí)現(xiàn)對(duì)典型目標(biāo)的識(shí)別,并開展多種算法的對(duì)比分析。開展室內(nèi)試驗(yàn),采集多種模擬場(chǎng)景光場(chǎng)點(diǎn)云數(shù)據(jù),驗(yàn)證光場(chǎng)相機(jī)在自動(dòng)駕駛應(yīng)用的可行性。

項(xiàng)目成果

1、 完成了畢業(yè)設(shè)計(jì)項(xiàng)目目標(biāo),對(duì)光場(chǎng)相機(jī)進(jìn)行了參數(shù)標(biāo)定并完成了大尺度深度校準(zhǔn)算法,可以對(duì)自動(dòng)駕駛中環(huán)境的深度信息進(jìn)行提取并且完成立體三維點(diǎn)云的重構(gòu),深度誤差10%,用時(shí)僅需1s左右。

2、 利用三維檢測(cè)器AVOD和PointRCNN融合了光場(chǎng)相機(jī)的圖像特征和三維點(diǎn)云特征,利用KITTI數(shù)據(jù)集對(duì)典型交通參與物完成了識(shí)別,識(shí)別準(zhǔn)確率大于70%且識(shí)別范圍可達(dá)70m。

3、利用深度學(xué)習(xí)的VoxelNet類方法和PointNet類方法對(duì)光場(chǎng)相機(jī)三維點(diǎn)云目標(biāo)識(shí)別進(jìn)行了實(shí)驗(yàn)分析對(duì)比,在30m和50m范圍內(nèi)激光雷達(dá)準(zhǔn)確率分別達(dá)到90%和70%,并在不同的環(huán)境下對(duì)比了光場(chǎng)相機(jī)的優(yōu)劣勢(shì)。