機電設計與知識工程研究所胡潔教授和戚進副研究員利用大語言模型和少樣本學習,提出了人機協(xié)作中意圖識別的創(chuàng)新性解決思路。該團隊近日在Journal of Manufacturing Systems上發(fā)表了題為“H2R Bridge: Transferring vision-language models to few-shot intention meta-perception in human robot collaboration”的研究論文,為推進工業(yè)智能化中的人機語義協(xié)同提供了重要技術支撐。博士生武對娣為第一作者,胡潔教授、戚進副研究員、香港理工大學鄭湃教授為共同通訊作者。

在工業(yè)4.0與5.0背景下,人機協(xié)作(HRC)成為現(xiàn)代制造系統(tǒng)智能化轉型的關鍵。意圖識別作為人機協(xié)作的核心環(huán)節(jié),現(xiàn)有的方法普遍依賴特定場景的大量標注數(shù)據(jù),缺乏對新任務與未見類別的泛化能力,難以應對實際工業(yè)環(huán)境中“數(shù)據(jù)稀缺”的挑戰(zhàn)。

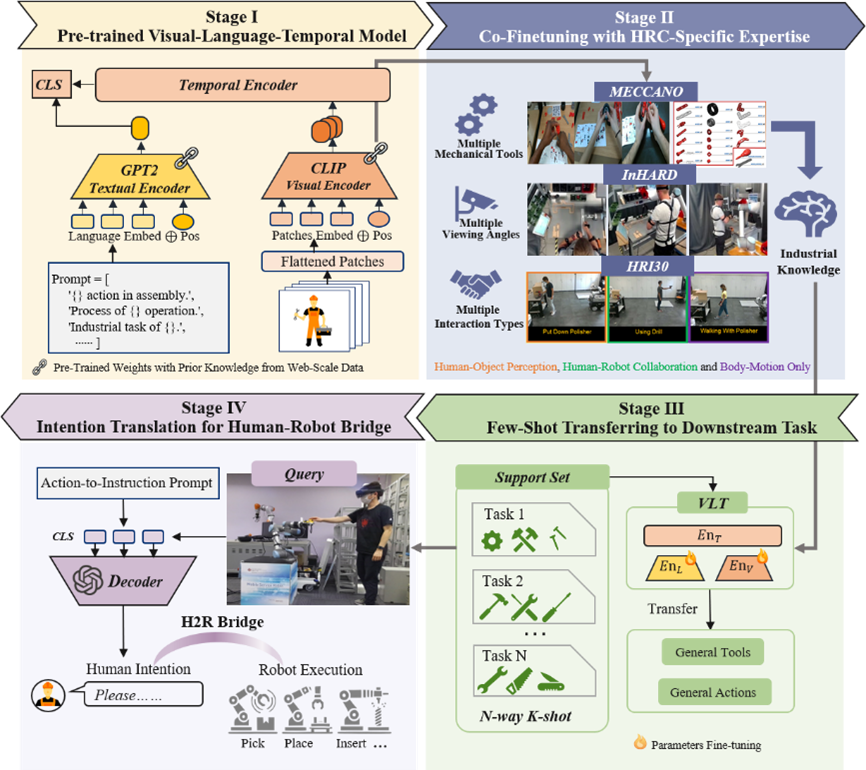

研究提出了一種新的視覺-語言-時間(Visual-Language-Temporal)多模態(tài)方法,基于GPT2語言編碼器和CLIP視覺編碼器構建,包含四個關鍵步驟。結合工業(yè)場景提示,利用大模型的先驗知識,并通過微調賦予其工業(yè)和機械裝配領域的專業(yè)能力。在下游任務中,引入語言作為監(jiān)督信號,利用少樣本學習實現(xiàn)知識的高效遷移與泛化,實現(xiàn)跨域意圖的“元感知”。

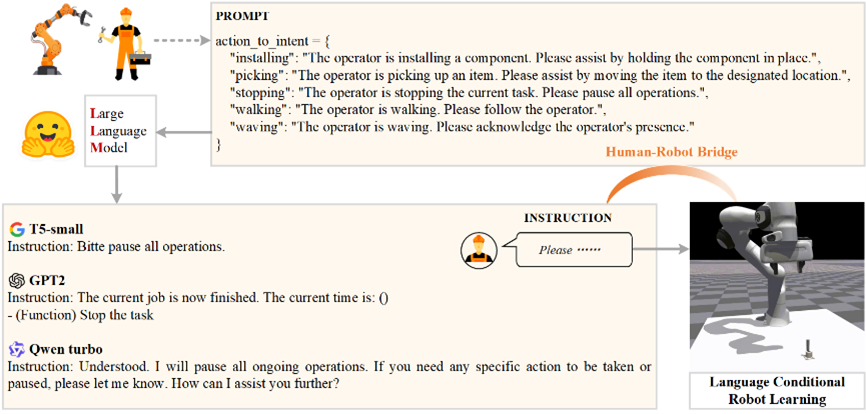

在多機械工具、多相機視角、多交互方式的人機交互數(shù)據(jù)集上的實驗表明,該方法在意圖識別準確性和模型泛化能力方面均優(yōu)于現(xiàn)有方法。在與香港理工大學聯(lián)合開展的少樣本實驗中,在每類僅有5個樣本的條件下,模型在工業(yè)任務中仍可達到92%的準確率,展現(xiàn)出顯著的樣本學習效率。通過3種大型語言模型將感知動作解碼映射為語義指令,為語言條件策略奠定基礎。

該研究實現(xiàn)了從動作感知到語義意圖的高效轉換,在人機交互中構建了“Human-to-Robot”的語義橋梁(H2R Bridge),為實現(xiàn)語言條件策略學習、主動交互與低成本任務遷移奠定了堅實基礎,并為大型多模態(tài)模型在智能制造領域的應用邁出了關鍵一步。

論文鏈接:https://doi.org/10.1016/j.jmsy.2025.03.016